2024 Nexus. Una breve historia de las redes de información desde la Edad de Piedra hasta la IA. Yuval Noah Harari.

Prólogo

Prólogo

Hemos llamado a nuestra especie Homo sapiens, el «humano sabio». Pero es discutible que hayamos estado a la altura de este nombre.

Lo cierto es que, a lo largo de los últimos cien mil años, nosotros, los sapiens, hemos acumulado un poder enorme. Tan solo listar todos nuestros descubrimientos, inventos y conquistas llenaría volúmenes. Pero el poder no es sabiduría y, después de cien mil años de descubrimientos, inventos y conquistas, la humanidad se ha visto abocada a una crisis existencial autoinfligida. Nos hallamos al borde de un colapso ecológico causado por el mal uso de nuestro propio poder. También nos afanamos en la creación de nuevas tecnologías como la inteligencia artificial (IA), que tienen el potencial de escapar de nuestro control y de esclavizarnos o aniquilarnos. Pero, lejos de que nuestra especie haya unido fuerzas para abordar estos retos existenciales, las tensiones internacionales van en aumento, la cooperación global se está haciendo más difícil, las naciones acumulan armas apocalípticas y una nueva guerra mundial no parece imposible.

Si los sapiens somos tan sabios, ¿por qué somos tan autodestructivos?

A un nivel más profundo, aunque hemos acumulado muchísima información acerca de todo, ya sean moléculas de ADN o galaxias remotas, no parece que toda esta información haya dado respuesta a las grandes preguntas de la vida: ¿quiénes somos?, ¿a qué debemos aspirar?, ¿qué es una buena vida?, ¿y cómo deberíamos vivirla? A pesar de la ingente cantidad de información que tenemos a nuestra disposición, somos tan susceptibles a la fantasía y al delirio como nuestros antepasados más lejanos. El nazismo y el estalinismo no son más que dos ejemplos recientes de una locura de masas que de vez en cuando se apodera incluso de las sociedades modernas. Nadie discute que en la actualidad los humanos dispongamos de mucha más información y de mucho más poder que en la Edad de Piedra, pero no es en absoluto cierto que nos comprendamos y que comprendamos mejor nuestro papel en el universo.

¿Por qué somos tan buenos a la hora de acumular más información y poder pero tenemos mucho menos éxito a la hora de adquirir sabiduría? A lo largo de la historia, un buen número de tradiciones han creído que un defecto letal en nuestra naturaleza nos incita a andar detrás de poderes que no sabemos manejar. El mito griego de Faetón nos habla de un muchacho que descubre que es hijo de Helios, el dios sol. Ansioso por demostrar su origen divino, Faetón se atribuye el privilegio de conducir el carro del sol. Helios le advierte que ningún humano puede controlar a los caballos celestes que tiran del carro solar. Pero Faetón insiste, hasta que el dios sol cede. Después de elevarse orgulloso en el cielo, Faetón acaba por perder el control del carro. El sol se desvía de su trayectoria, abrasa toda la vegetación, provoca gran cantidad de muertes y amenaza con quemar la Tierra misma. Zeus interviene y alcanza a Faetón con un rayo. El presuntuoso humano cae del cielo como una estrella fugaz, envuelto en llamas. Los dioses retoman el control del cielo y salvan el mundo.

Dos mil años después, cuando la Revolución Industrial daba sus primeros pasos y las máquinas empezaban a sustituir a los humanos en numerosas tareas, Johann Wolfgang von Goethe publicó un texto admonitorio similar titulado «El aprendiz de brujo». El poema de Goethe (que posteriormente se popularizó en la versión animada de Walt Disney protagonizada por Mickey Mouse) cuenta cómo un brujo ya anciano deja su taller en manos de un joven aprendiz, a quien pide que, en su ausencia, se encargue de tareas como traer agua del río. El aprendiz decide facilitarse las cosas y, recurriendo a uno de los conjuros del brujo, lanza un hechizo sobre una escoba para que vaya a por el agua. Pero el aprendiz no sabe cómo detener la escoba, que, incansable, trae cada vez más agua, lo que amenaza con inundar el taller. Presa del pánico, el aprendiz corta la escoba encantada en dos con un hacha solo para ver que cada mitad se convierte en otra escoba. Ahora hay dos escobas encantadas que inundan el taller con cubos de agua. Cuando el viejo brujo regresa, el aprendiz le suplica ayuda: «Los espíritus a los que invoqué […] ahora no puedo librarme de ellos». De inmediato, el brujo deshace el hechizo y detiene la inundación. La lección para el aprendiz —y para la humanidad— es clara: nunca recurras a poderes que no puedas controlar.

¿Qué nos dicen las fábulas conminatorias del aprendiz y de Faetón en el siglo XXI? Es obvio que los humanos nos hemos negado a hacer caso de sus advertencias. Ya hemos provocado un desequilibrio en el clima terrestre y puesto en acción a miles de millones de escobas encantadas, drones, chatbots y otros espíritus algorítmicos con capacidad para escapar a nuestro control y desatar una inundación de consecuencias incalculables.

Así, pues, ¿qué debemos hacer? Las fábulas no ofrecen ninguna respuesta, a no ser que esperemos que un dios o un brujo nos salven. Desde luego, este es un mensaje extremadamente peligroso, pues anima a la gente a renunciar a la responsabilidad y a confiar en dioses y brujos. Peor todavía, nos impide reconocer que dioses y brujos son una invención humana... como lo son los carros, las escobas y los algoritmos. La tendencia a crear artefactos poderosos con capacidades imprevistas no se inició con el invento de la máquina de vapor ni con la IA, sino con el de la religión. Profetas y teólogos han invocado espíritus poderosos que se suponía que aportarían amor y alegría, pero que de tanto en tanto terminaron regando el mundo de sangre.

El mito de Faetón y el poema de Goethe no proporcionan un consejo útil porque malinterpretan la manera en que los humanos solemos hacernos con el poder. En ambas fábulas, un único humano adquiere un poder enorme, pero después se ve corrompido por la soberbia y la codicia. La conclusión es que nuestra psicología individual imperfecta provoca que abusemos del poder. Lo que este análisis aproximado pasa por alto es que el poder humano nunca es el resultado de una iniciativa individual. El poder siempre surge de la cooperación entre un gran número de personas.

Por consiguiente, no es nuestra psicología individual lo que provoca que abusemos del poder. Al fin y al cabo, junto con la codicia, la soberbia y la crueldad, los humanos somos capaces de amar, de compadecernos, de ser humildes y de sentir alegría. Sin duda, entre los peores miembros de nuestra especie abundan la codicia y la crueldad, que llevan a los malos actores a abusar del poder. Pero ¿por qué elegirían las sociedades humanas encomendar el poder a sus peores representantes? Por ejemplo, en 1933 la mayoría de los alemanes no eran psicópatas. Entonces, ¿por qué votaron a Hitler?

Nuestra tendencia a invocar poderes que somos incapaces de controlar no surge de la psicología individual, sino de la singular manera en que tiene lugar la cooperación entre un gran número de individuos en nuestra especie. El argumento principal de este libro es que la humanidad consigue un poder enorme mediante la construcción de grandes redes de cooperación, pero la forma en que se construyen dichas redes las predispone a hacer un uso imprudente del poder. Nuestro problema, por lo tanto, tiene que ver con las redes.

Más concretamente, es un problema de información. La información es el pegamento que mantiene unidas las redes. Pero, durante miles de años, los sapiens construyeron y mantuvieron grandes redes al inventar y expandir ficciones, fantasías, ilusiones: sobre dioses, sobre palos de escoba encantados, sobre la IA y sobre muchas otras cosas. Mientras que cada individuo humano suele interesarse por conocer la verdad acerca de sí mismo y del mundo, las grandes redes ponen en contacto a sus miembros y crean orden al generar dependencia en ficciones y fantasías. Así es como, por ejemplo, vimos surgir el nazismo y el estalinismo. Estas eran unas redes poderosísimas sostenidas por ideas excepcionalmente equivocadas. Tal como afirmó con acierto George Orwell, la ignorancia es fuerza.

El hecho de que los regímenes nazi y estalinista se fundaran sobre fantasías crueles y mentiras cargadas de cinismo no los hizo excepcionales desde el punto de vista histórico, ni los predestinó al hundimiento. El nazismo y el estalinismo han sido dos de las redes más poderosas jamás creadas por el ser humano. A finales de 1941 y principios de 1942, los poderes del Eje estaban a punto de ganar la Segunda Guerra Mundial. Al final, Stalin se erigió como vencedor de la guerra, y en las décadas de 1950 y 1960 tanto él como sus sucesores manejaron una probabilidad razonable de ganar la Guerra Fría. En la década de 1990, las democracias liberales tomaron la delantera, pero ahora esta se nos antoja una victoria transitoria. En el siglo XXI, cualquier nuevo régimen totalitario podría tener éxito allí donde Hitler y Stalin fracasaron, creando una red todopoderosa que evite que las generaciones futuras traten siquiera de destapar sus mentiras y ficciones. No deberíamos dar por sentado que las redes ilusorias están destinadas al fracaso. Si queremos evitar su triunfo, tenemos un trabajo duro por delante.

LA IDEA INGENUA DE LA INFORMACIÓN

Es difícil apreciar la fuerza de las redes ilusorias debido a la enorme confusión que rodea al modo en que operan las grandes redes de información, sean o no ilusorias. Esta confusión se resume en lo que yo denomino «la idea ingenua de la información». Mientras que fábulas como «El aprendiz de brujo» o mitos como el de Faetón presentan un enfoque claramente pesimista de la psicología humana individual, la idea ingenua de la información ofrece un enfoque demasiado optimista de las redes humanas a gran escala.

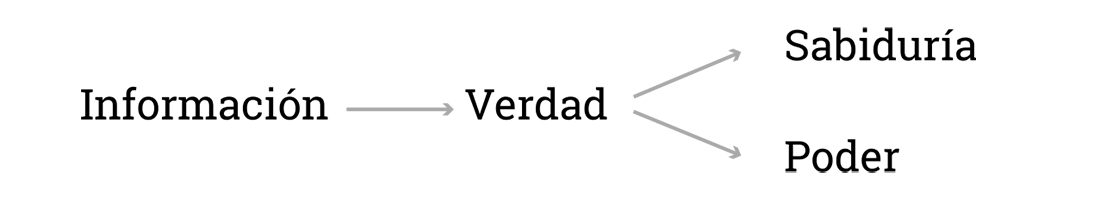

La idea ingenua aduce que, al hacer acopio y procesar mucha más información de la que pueden recabar los individuos por sí solos, las grandes redes alcanzan un mayor conocimiento en campos como la medicina, la física, la economía y otros muchos, lo que hace que la red no solo sea poderosa, sino también sabia. Por ejemplo, al recabar información sobre patógenos, las compañías farmacéuticas y los servicios sanitarios pueden determinar las causas reales de muchas enfermedades, lo que les permite desarrollar medicinas más efectivas y tomar decisiones más sensatas sobre cómo administrarlas. Este punto de vista plantea que, en cantidades suficientes, la información conduce a la verdad y, a su vez, la verdad conduce al poder y a la sabiduría. En cambio, la ignorancia parece no llevar a ninguna parte. Si bien en contextos de crisis históricas a veces pueden surgir redes ilusorias o engañosas, a la larga estas están destinadas a fracasar frente a rivales más perspicaces y honestos. Un servicio de atención sanitaria que ignore la información disponible sobre patógenos o un gigante de la industria farmacéutica que difunda desinformación de manera deliberada acabarán por sucumbir ante competidores que hagan un uso más sensato de la información. De modo que la idea ingenua implica que las redes ilusorias han de ser anormalidades y que por lo general puede confiarse en que las grandes redes manejen el poder con sensatez.

La idea ingenua de la información

Desde luego, la idea ingenua reconoce que muchas cosas pueden funcionar mal en el camino que va de la información a la verdad. Podemos cometer errores involuntarios al reunir y procesar información. Actores maliciosos movidos por la codicia o el odio podrían ocultarnos hechos importantes o intentar engañarnos. Como resultado, a veces la información conduce al error en lugar de a la verdad. Por ejemplo, la información parcial, un análisis incorrecto o una campaña de desinformación podrían llevar incluso a que los expertos identifiquen erróneamente la causa real de una enfermedad determinada.

Sin embargo, la idea ingenua asume que la solución a la mayoría de los problemas que nos encontramos al recabar y procesar información consiste en recabar y procesar todavía más información. Aunque nunca estamos completamente a salvo del error, en la mayoría de los casos más información significa mayor precisión. Un único médico que quiera identificar la causa de una epidemia examinando a un solo paciente cuenta con menos probabilidades de éxito que mil médicos que obtengan datos de millones de pacientes. Y, si son los propios profesionales de la medicina quienes conspiran para ocultar la verdad, el hecho de que la información médica esté en mayor medida a la libre disposición del público y de los investigadores acabará por revelar el fraude. Según esta idea, cuanto mayor sea la red de información, más cerca se hallará de la verdad.

Por supuesto, analizar la información en detalle y descubrir verdades importantes no garantiza que usemos sabiamente las capacidades resultantes. Por lo general, se entiende que sabiduría significa «tomar decisiones correctas», pero el significado de «correctas» depende de unos juicios de valor que difieren entre personas, culturas o ideologías. Los científicos que descubren un patógeno nuevo pueden desarrollar una vacuna para proteger a la población. Pero, si estos científicos —o sus amos políticos— profesan una ideología racista que propugna que ciertas razas son inferiores y que han de ser exterminadas, el nuevo conocimiento médico podría usarse para desarrollar un arma biológica que mate a millones de personas.

También en este caso, la idea ingenua de la información sostiene que la información adicional al menos ofrece un remedio parcial. La idea ingenua considera que, si se examinan a fondo, las discrepancias acerca de los valores son producto de la falta de información o de la desinformación intencionada. Según esta idea, un racista es alguien mal informado que simplemente desconoce la realidad de la biología y de la historia. Alguien que cree que la «raza» es una categoría biológica válida y a quien una serie de teorías conspiratorias espurias han lavado el cerebro. Por lo tanto, el antídoto contra el racismo es proporcionar a la gente más realidades biológicas e históricas. Puede que lleve su tiempo, pero, en un libre mercado de la información, la verdad prevalecerá tarde o temprano.

Desde luego, la idea ingenua contiene más matices y reflexiones de los que pueden explicarse en unos pocos párrafos, pero su principio fundamental es que la información es esencialmente algo bueno y que, cuanta más podamos reunir, mejor. Con la información y el tiempo suficientes, estamos destinados a descubrir la verdad sobre asuntos que pueden ir de las infecciones víricas a los prejuicios racistas, con lo cual desarrollaremos no solo nuestro poder, sino también la sabiduría necesaria para emplearlo con acierto.

Esta visión ingenua justifica la búsqueda de tecnologías de la información cada vez más potentes y ha sido la ideología semioficial de la era de la informática y de internet. En junio de 1989, pocos meses antes de la caída del Muro de Berlín y del Telón de Acero, Ronald Reagan declaraba que «el Goliat del control totalitario será pronto derribado por el David del microchip» y que «el mayor de los Grandes Hermanos se halla cada vez más desvalido frente a la tecnología de las comunicaciones [...]. La información es el oxígeno de la era moderna [...]. Se filtra a través de los muros rematados con alambre de espino. Planea sobre las fronteras electrificadas y repletas de trampas. Brisas de rayos electrónicos soplan a través del Telón de Acero como si este fuera de encaje». En noviembre de 2009, durante una visita a Shanghái, Barack Obama se dirigió con el mismo espíritu a sus anfitriones chinos: «Creo firmemente en la tecnología y creo firmemente en la apertura cuando se trata del flujo de información. Considero que, cuanta más libertad haya en el flujo de información, más fuerte será la sociedad».

A menudo, empresarios y compañías se han referido a la tecnología de la información con un optimismo similar. Ya en 1858, un editorial de The New Englander sobre la invención del telégrafo afirmaba: «Es imposible que sigan existiendo viejos prejuicios y hostilidades, ahora que se ha creado este instrumento para que todas las naciones de la Tierra intercambien ideas». Casi dos siglos y dos guerras mundiales después, Mark Zuckerberg decía que el objetivo de Facebook era «ayudar a la gente a compartir más con el fin de hacer que el mundo sea más abierto y promover el entendimiento entre personas».

En su libro de 2024 The Singularity is Nearer, el eminente futurólogo y empresario Ray Kurzweil examina la historia de la tecnología de la información y concluye que «lo cierto es que casi todos los aspectos de la vida están mejorando como resultado del avance exponencial de la tecnología». Al repasar lo sucedido a lo largo de la historia de la humanidad, Kurzweil cita ejemplos como la invención de la imprenta para aducir que, por su naturaleza, la tecnología de la información tiende a generar «un círculo virtuoso que facilita el avance de casi todos los aspectos del bienestar humano, entre ellos la alfabetización, la educación, la riqueza, las medidas sanitarias, la salud, la democratización y la reducción de la violencia».

La idea ingenua de la información quizá quede plasmada de manera más sucinta en la declaración de la misión de Google «para organizar la información mundial y hacerla universalmente accesible y útil». La respuesta de Google a las advertencias de Goethe es que, aunque haya probabilidades de que, al robar el libro de hechizos de su maestro, un solo aprendiz cause desastres, si hay muchos aprendices con libre acceso a toda la información del mundo, estos no solo crearán escobas encantadas que les sean útiles, sino que también aprenderán a manejarlas con sabiduría.

GOOGLE CONTRA GOETHE

Debe señalarse que existen numerosos casos en los que contar con más información sí ha permitido que los humanos entendamos mejor el mundo y que hagamos un uso más sabio de nuestro poder. Pensemos, por ejemplo, en la espectacular reducción de la mortalidad infantil. Johann Wolfgang von Goethe era el mayor de siete hermanos, pero solo él y su hermana Cornelia llegaron a celebrar su séptimo cumpleaños. La enfermedad se llevó a su hermano Hermann Jacob a los seis años de edad, a su hermana Catharina Elisabeth a los cuatro, a su hermana Johanna Maria a los dos y a su hermano Georg Adolf a los ocho meses; un quinto hermano, sin nombre, nació muerto. Después, Cornelia murió de enfermedad a los veintiséis años, lo que dejó a Johann Wolfgang como el único superviviente de la familia.

Johann Wolfgang von Goethe tuvo cinco hijos, de los que ninguno, excepto el mayor —August—, llegó a las dos semanas de vida. Con toda probabilidad, la causa fue la incompatibilidad entre los grupos sanguíneos de Goethe y su esposa, Christiane, lo cual, después del primer embarazo exitoso, llevó a la madre a desarrollar anticuerpos para la sangre fetal. Esta afección, conocida como incompatibilidad Rh, en la actualidad se trata de manera tan efectiva que su tasa de mortalidad es inferior al 2 por ciento, pero en la década de 1790 era del 50 por ciento, y para los cuatro hijos menores de Goethe supuso una sentencia de muerte.

En total, entre los Goethe, una familia alemana pudiente de finales del siglo XVIII, la tasa de supervivencia infantil fue de un catastrófico 25 por ciento. De un total de doce niños, solo tres llegaron a la edad adulta. Una estadística tan espantosa no era excepcional. Por la época en que Goethe escribió «El aprendiz de brujo», en 1797, se estima que solo alrededor del 50 por ciento de los niños alemanes alcanzaban los quince años de edad, y es probable que ocurriera lo mismo en la mayor parte del mundo. A nivel mundial, en 2020, el 95,6 por ciento de los niños vivía más allá de su decimoquinto cumpleaños, y en Alemania la estadística era del 99,5 por ciento. Este logro trascendental no habría sido posible si no se hubiesen recolectado, analizado y compartido enormes cantidades de datos médicos sobre cuestiones tales como los grupos sanguíneos. Así, pues, en este caso la idea ingenua de la información resultó ser acertada.

Sin embargo, la idea ingenua de la información ofrece nada más que una parte del panorama, y la historia de la era moderna no solo se centró en la reducción de la mortalidad infantil. En épocas recientes, la humanidad ha experimentado un aumento sin precedentes en la cantidad y la velocidad de la producción de información. Cualquier teléfono inteligente contiene más información que la antigua Biblioteca de Alejandría y permite a su propietario entrar en contacto instantáneo con miles de millones de personas de todo el mundo. Pero, con tanta información circulando a velocidades impresionantes, la humanidad se halla más cerca que nunca de la aniquilación.

A pesar de —o quizá debido a— la acumulación de datos, seguimos arrojando a la atmósfera gases de efecto invernadero, contaminamos ríos y mares, talamos bosques, destruimos hábitats enteros, condenamos a innumerables especies a la extinción y ponemos en peligro los cimientos ecológicos de nuestra especie. También producimos armas de destrucción masiva cada vez más poderosas, desde bombas termonucleares hasta virus que pueden suponer la total aniquilación de la humanidad. Nuestros líderes no carecen de información acerca de estos peligros, pero, en lugar de colaborar en la búsqueda de soluciones, se acercan cada vez más a una guerra global.

Disponer cada vez de más información ¿hará que las cosas mejoren? ¿O hará que empeoren? Pronto lo descubriremos. Numerosas empresas y gobiernos se hallan inmersos en una carrera por desarrollar la tecnología de la información más poderosa de la historia, la inteligencia artificial (IA). Empresarios destacados como el inversor estadounidense Marc Andreessen creen que la IA acabará por resolver todos los problemas de la humanidad. El 6 de junio de 2023, Andreessen publicó un ensayo titulado «Por qué la IA salvará el mundo» que salpicó de afirmaciones tan atrevidas como: «Estoy aquí para dar a conocer una buena noticia: la IA no destruirá el mundo, y de hecho puede salvarlo», o «la IA puede mejorar todo aquello que nos importa». Y concluía: «El desarrollo y la proliferación de la IA, lejos de un riesgo que deberíamos temer, es una obligación moral que asumimos para con nosotros mismos, nuestros hijos y nuestro futuro».

En esta línea, Ray Kurzweil afirma en The Singularity Is Nearer que «la IA es una tecnología esencial que nos permitirá hacer frente a los retos apremiantes que tenemos por delante, entre los que se incluyen la enfermedad, la pobreza, la degradación ambiental y todas nuestras debilidades humanas. Tenemos el imperativo moral de hacer realidad la promesa de las nuevas tecnologías». Kurzweil es profundamente consciente de los posibles peligros de la tecnología y los analiza con detalle, pero cree que pueden mitigarse con éxito.

Otros son más escépticos. No solo filósofos y científicos sociales, sino también conocidos expertos en IA y empresarios como Yoshua Bengio, Geoffrey Hinton, Sam Altman, Elon Musk y Mustafa Suleyman han advertido al público sobre cómo la IA puede destruir nuestra civilización. Un artículo firmado por Bengio, Hinton y un buen número expertos señalaba que «el avance sin restricciones de la IA podría culminar en una reducción de la vida y de la biosfera a gran escala, así como en la marginación e incluso en la extinción de la humanidad». En una encuesta de 2023 en la que participaron 2.778 investigadores de IA, más de un tercio estimó en al menos un 10 por ciento la probabilidad de que la IA avanzada conduzca a resultados tan negativos como la extinción humana. En 2023, cerca de treinta gobiernos —entre ellos los de China, Estados Unidos y Reino Unido— firmaron la Declaración de Bletchley sobre la IA, en la que se reconocía que «cabe la posibilidad de un daño grave, incluso catastrófico, ya sea deliberado o no intencionado, que surge de las capacidades más relevantes de estos modelos de IA». Al emplear términos tan apocalípticos, los expertos y los gobiernos no pretenden conjurar una escena hollywoodiense de robots rebeldes que corren por las calles y disparan contra la población. Este es un supuesto poco probable, y no hace más que desviar el foco de los peligros reales. Los expertos, en cambio, alertan sobre otras dos posibilidades.

En primer lugar, el poder de la IA podría sobrecargar los conflictos humanos ya existentes y dividir a la humanidad en una lucha contra sí misma. Así como en el siglo XX el Telón de Acero dividió a las potencias rivales durante la Guerra Fría, en el siglo XXI el Telón de Silicio —constituido por chips de silicio y códigos informáticos en lugar de por alambre de espino— podría llegar a dividir a las potencias rivales en un nuevo conflicto global. Debido a que la carrera armamentística de la IA producirá armas cada vez más destructivas, incluso una pequeña chispa podría causar un incendio cataclísmico.

En segundo lugar, el Telón de Silicio podría no generar una división entre dos grupos de humanos, sino más bien entre los humanos y sus nuevos jefes supremos de IA. Con independencia de dónde vivamos, podríamos vernos envueltos por una red de algoritmos incomprensibles cuya función sería gestionar nuestras vidas, remodelar nuestras políticas y nuestras culturas, e incluso rediseñar nuestro cuerpo y nuestra mente; al mismo tiempo, nos resultaría imposible entender las fuerzas que nos controlan, no hablemos ya de detenerlas. Si una red totalitaria del siglo XXI consigue conquistar el mundo, puede que no se encuentre gobernada por un dictador de carne y hueso, sino por una inteligencia no humana. Aquellos que señalan a China, a Rusia o a unos Estados Unidos posdemocráticos como fuente principal de pesadillas totalitarias malinterpretan el peligro. De hecho, chinos, rusos, estadounidenses y el resto del mundo nos hallamos amenazados conjuntamente por el potencial totalitario de la inteligencia no humana.

Dada la magnitud del peligro, la IA debería ser un tema de interés para todos los seres humanos. Aunque no todos podemos ser expertos en IA, sí hemos de tener presente que es la primera tecnología de la historia que puede tomar decisiones y generar nuevas ideas por sí misma. Todo invento humano previo ha servido para conferir poder a los humanos, porque, con independencia del alcance que tuviera la nueva herramienta, las decisiones acerca de su uso se han mantenido en nuestras manos. Los cuchillos y las bombas no deciden por sí mismos a quien matar. Son instrumentos sin criterio que carecen de la inteligencia necesaria para procesar información y tomar decisiones independientes. En cambio, la IA puede procesar información por sí sola y, por lo tanto, sustituir a los humanos en la toma de decisiones. La IA no es una herramienta, es un agente.

Asimismo, el control de la información permite a la IA generar nuevas ideas de manera independiente, en campos que van desde la música hasta la medicina. Los gramófonos reproducían nuestra música y los microscopios revelaban los secretos de nuestras células, pero los gramófonos no podían componer nuevas sinfonías ni los microscopios sintetizar nuevas medicinas. La IA ya es capaz de producir arte y de efectuar descubrimientos científicos por su cuenta. Es probable que en las próximas décadas adquiera incluso la capacidad de crear nuevas formas de vida, ya sea a través de la escritura de código genético o de la invención de un código inorgánico que anime entes inorgánicos.

Incluso en el momento actual, en la fase embrionaria de la revolución de la IA, los ordenadores toman decisiones por nosotros: la concesión de una hipoteca, un contrato de trabajo o la imposición de una pena de cárcel. Esta tendencia no hará más que aumentar y acelerarse, lo que nos dificultará la comprensión de nuestra propia vida. ¿Podemos confiar en los algoritmos informáticos para tomar decisiones sensatas y construir un mundo mejor? Este es un juego mucho más serio que confiar en que una escoba encantada achique agua. Y estamos poniendo en riesgo más que vidas humanas. La IA puede alterar el curso no solo de la historia de nuestra especie, sino de la evolución de todos los seres vivos.

CONVERTIR LA INFORMACIÓN EN UN ARMA

En 2016 publiqué Homo Deus, un libro que incidía en algunos de los peligros que las nuevas tecnologías de la información plantean a la humanidad. El ensayo sostenía que el verdadero héroe de la historia siempre ha sido la información, en lugar de Homo sapiens, y que los científicos entienden cada vez más no solo la historia, sino también la biología, la política y la economía en términos de flujos de información. Los animales, los estados y los mercados son redes de información que absorben datos del entorno que los rodea, toman decisiones y, a su vez, facilitan datos. El libro avisa de que, mientras esperamos que una mejor tecnología de la información nos proporcione salud, felicidad y poder, en realidad podría quitarnos ese poder y destruir nuestra salud tanto física como mental. Homo Deus desarrollaba la hipótesis de que, si no somos cuidadosos, los humanos podríamos disolvernos en el torrente de información como un terrón en un río caudaloso y de que en el gran orden de las cosas la humanidad pasaría a no ser más que una pequeña onda dentro del flujo de datos cósmico.

En los años posteriores a la publicación de Homo Deus, el ritmo del cambio se ha acelerado, y ya es una realidad que el poder se ha transferido de los humanos a los algoritmos. Muchos de los supuestos que en 2016 sonaban a ciencia ficción —como algoritmos capaces de crear arte haciéndose pasar por seres humanos, de tomar decisiones cruciales para nuestra vida y de saber más cosas sobre nosotros que nosotros mismos— son realidades con las que convivimos en 2024.

Otras muchas cosas han cambiado desde 2016. La crisis ecológica se ha agudizado, las tensiones internacionales se han incrementado y una oleada populista ha socavado incluso la cohesión de las democracias más sólidas. El populismo también ha orquestado un desafío radical para la idea ingenua de la información. Líderes populistas como Donald Trump o Jair Bolsonaro, movimientos populistas como QAnon y teorías de la conspiración como las de los antivacunas han aducido que toda institución tradicional que ve reforzada su autoridad bajo el argumento de recopilar información y descubrir la verdad simplemente está mintiendo. Burócratas, jueces, médicos, periodistas convencionales y expertos académicos forman parte de una camarilla de élite que no tiene ningún interés por la verdad y que, de manera deliberada, difunde desinformación para obtener poder y privilegios a expensas del «pueblo». El auge de políticos como Trump y de movimientos como QAnon se produce en un contexto político específico, propio de las condiciones de Estados Unidos durante los últimos años de la década de 2010. Pero el populismo como una visión antisistema del mundo es muy anterior a Trump y es relevante para otros muchos contextos históricos actuales y futuros. En resumen, el populismo considera la información como un arma.

La idea populista de la información

En sus versiones más extremas, el populismo postula que en absoluto existe una verdad objetiva, y que cada cual tiene «su propia verdad», de la que se sirve para derrotar a sus rivales. Según esta opinión, el poder es la única realidad. Toda interacción social es una lucha por el poder, porque lo único que interesa a los humanos es el poder. Decir que nos interesa algo distinto —como la verdad o la justicia— no es más que una estratagema para alcanzar el poder. Allí donde el populismo divulga con éxito la idea de la información como un arma, el propio lenguaje se ve debilitado. Sustantivos tales como «hechos» y adjetivos como «exacto» y «verdadero» se vuelven imprecisos. No se considera que estos términos señalen una realidad objetiva común. En su lugar, cualquier conversación sobre «hechos» o «verdad» está destinada a que por lo menos ciertas personas pregunten: «¿A qué hechos y a qué verdad se está refiriendo usted?».

Cabe insistir en que esta idea de la información centrada en el poder y profundamente escéptica no es un fenómeno nuevo ni la inventaron los antivacunas, los terraplanistas, los bolsonaristas ni los partidarios de Trump. Se propagaron opiniones similares mucho antes de 2016, incluso por parte de algunas de las mentes más brillantes de la humanidad. A finales del siglo XX, por ejemplo, intelectuales de la izquierda radical como Michel Foucault o Edward Said afirmaron que instituciones científicas como hospitales y universidades no buscan verdades atemporales y objetivas, sino que, al servicio de las élites capitalistas y colonialistas, hacen uso del poder para determinar qué se considera verdad. En ocasiones, estas críticas radicales llegaron a afirmar que los «hechos científicos» no son sino un «discurso» capitalista o colonialista, y que en realidad aquellos que ocupan el poder nunca estarán interesados en la verdad ni se puede confiar en que reconozcan o corrijan sus errores.

Esta línea de pensamiento izquierdista radical se remonta a Karl Marx, que en el siglo XIX adujo que el poder es la única realidad, que la información es un arma y que las élites que afirman servir a la verdad y la justicia en realidad persiguen angostos privilegios de clase. Tal como se afirma en el Manifiesto comunista, de 1848, «la historia de toda sociedad hasta nuestros días no ha sido sino la historia de la lucha de clases. Hombres libres y esclavos, patricios y plebeyos, nobles y siervos, maestros y oficiales; en una palabra, opresores y oprimidos, en lucha constante, mantuvieron una guerra ininterrumpida, ya abierta, ya disimulada». Esta interpretación binaria de la historia implica que toda interacción humana es una lucha por el poder entre opresores y oprimidos. Por consiguiente, siempre que alguien diga algo, la pregunta no ha de ser «¿qué ha dicho? ¿Es cierto?», sino más bien «¿quién lo dice? ¿A qué privilegios sirve?».

Desde luego, es poco probable que populistas de derechas como Trump y Bolsonaro, que de hecho se presentan como antimarxistas furibundos, hayan leído a Foucault o a Marx. También difieren mucho de los marxistas en las políticas que proponen en materia de impuestos y de prestaciones sociales. Pero, en esencia, su opinión sobre la sociedad y la información es sorprendentemente marxista, pues ven toda interacción humana como una lucha por el poder entre opresores y oprimidos. Por ejemplo, en 2017, durante su discurso de investidura, Trump anunció que «un grupúsculo de la capital de nuestra nación ha disfrutado de las recompensas de gobernar mientras el pueblo ha cargado con el coste». Esta retórica es una de las bases del populismo, que el politólogo Cas Mudde ha descrito como una «ideología que considera que la sociedad está dividida en último término en dos grupos homogéneos y antagonistas, “la gente pura” y “la élite corrupta”». Así como los marxistas afirmaban que los medios de comunicación funcionan como un portavoz de la clase capitalista y que instituciones científicas como las universidades difunden desinformación con el fin de perpetuar el control capitalista, los populistas acusan a estas mismas instituciones de trabajar para promover los intereses de las «élites corruptas» a expensas del «pueblo».

Los populistas de hoy adolecen de la misma incoherencia que lastró a los movimientos antisistema radicales de las generaciones previas. ¿Qué implicaciones tiene para los propios populistas que el poder sea la única realidad y la información solo un arma? ¿También ellos tienen el poder como único interés?, ¿y también nos mienten para alcanzarlo?

Los populistas han intentado zafarse de este enigma por dos vías distintas. Algunos movimientos populistas juran lealtad a los ideales de la ciencia moderna y a las tradiciones del empirismo escéptico. Instan a la gente a desconfiar de toda institución y figura de autoridad… incluidos los partidos y los políticos autoproclamados populistas. En cambio, uno debe «llevar a cabo su propia investigación» y confiar solo en lo que puede ver con sus propios ojos. Esta postura empírica radical implica que, dado que las instituciones a gran escala —como los partidos políticos, los tribunales, los periódicos y las universidades— no son de fiar, los individuos que persistan aún podrán encontrar la verdad por sí mismos.

Este enfoque puede parecer científico y atraer a los individuos de espíritu libre, pero deja abierta la pregunta de cómo pueden cooperar las comunidades humanas para construir sistemas de atención sanitaria o para aprobar normas medioambientales que exijan una organización institucional a gran escala. ¿Es capaz un único individuo de efectuar toda la investigación necesaria para decidir si el calentamiento global es una realidad y qué habría que hacer al respecto? ¿Cómo podría una sola persona recolectar datos climáticos de todo el mundo, no ya obtener registros fiables de siglos pasados? Confiar únicamente en «mi propia investigación» puede parecer científico, pero en la práctica supone creer que no existe una verdad objetiva. Tal como veremos en el capítulo 4, la ciencia es un trabajo institucional colaborativo, y no una búsqueda personal.

Una solución populista alternativa sería abandonar el ideal científico moderno de encontrar la verdad mediante la «investigación» para, en su lugar, entregarse a la revelación divina o al misticismo. A menudo, religiones tradicionales como el cristianismo, el islam y el hinduismo han caracterizado a los humanos como seres sedientos de poder en los que no se debe confiar y que pueden acceder a la verdad solo gracias a la intervención de una inteligencia divina. En la década de 2010 y durante los primeros años de la de 2020, los partidos populistas, desde Brasil hasta Turquía y desde Estados Unidos hasta la India, se han alineado con estas religiones tradicionales y han sido tajantes en cuanto a los recelos que les despiertan las instituciones modernas, al tiempo que declaraban su fe absoluta en las escrituras antiguas. Los populistas afirman que los artículos que leemos en The New York Times o en Science no son más que ardides elitistas para alcanzar el poder, mientras que lo que leemos en la Biblia, el Corán o los Vedas es la verdad absoluta.

Una variación de esta idea llama a la gente a depositar su confianza en líderes carismáticos como Trump o Bolsonaro, cuyos partidarios los representan ya como los mensajeros de Dios, ya como poseedores de una conexión mística con «el pueblo». Mientras que los políticos comunes mienten al pueblo con el fin de acumular poder, el líder carismático es el portavoz infalible del pueblo que saca a la luz todas las mentiras Una de las paradojas recurrentes del populismo es que al principio nos alerta de la sed de poder que controla a las élites humanas, pero con frecuencia acaba por confiar todo el poder a un humano ambicioso.

Exploraremos el populismo con mayor detalle en el capítulo 5, pero, llegados a este punto, es importante señalar que los populistas están erosionando la confianza en las instituciones a gran escala y en la cooperación internacional precisamente cuando la humanidad se enfrenta a retos existenciales como el colapso ecológico, la guerra global y la pérdida de control sobre la tecnología. En lugar de confiar en instituciones humanas complejas, el populismo nos aconseja lo mismo que el mito de Faetón y la fábula de «El aprendiz de brujo»: «Confía en Dios o en el gran brujo para que intervengan y lo corrijan todo». Si aceptamos este consejo, es probable que pronto nos encontremos bajo el control de la peor clase de humanos sedientos de poder y que a largo plazo sean unos nuevos jefes supremos de IA quienes nos controlen. O puede que no nos encontremos en ninguna parte, con la Tierra convertida en un lugar inhóspito para la vida humana.

Si no queremos ceder el poder a un líder carismático o a una IA inescrutable, primero hemos de entender mejor qué es la información, cómo ayuda a construir redes humanas y de qué manera se relaciona con la verdad y el poder. Los populistas tienen razón al sospechar de la idea ingenua de la información, pero se equivocan al pensar que el poder es la única realidad y que la información siempre es un arma. La información no es la materia prima de la verdad, pero tampoco es una simple arma. El espacio entre estos dos extremos es suficiente para proporcionarnos una visión más matizada y optimista de las redes de información humanas y de nuestra capacidad para manejar el poder con sensatez. Este libro se dedica a explorar ese terreno intermedio.

EL CAMINO QUE TENEMOS POR DELANTE

La primera parte de este libro se centra en el desarrollo histórico de las redes de información humanas. No intenta presentar un informe completo, a través de los siglos, de tecnologías de la información como la escritura, la imprenta y la radio. En lugar de ello, al estudiar algunos ejemplos, explora algunos de los dilemas clave a los que se enfrentaron personas de todas las épocas cuando intentaron construir redes de información, y examina de qué manera las diferentes respuestas a dichos dilemas dieron forma a diversas sociedades humanas. Lo que a menudo consideramos conflictos ideológicos y políticos suelen ser discrepancias entre distintos tipos de redes de información.

La parte I se inicia con un examen de dos principios que han sido esenciales para las redes de información humanas a gran escala: la mitología y la burocracia. Los capítulos 2 y 3 describen el modo en que las redes de información a gran escala —desde los reinos de la Antigüedad hasta los estados actuales— se han basado tanto en creadores de mitos como en burócratas. Los relatos de la Biblia, por ejemplo, fueron esenciales para la Iglesia cristiana, pero la Biblia no habría existido si los burócratas de la Iglesia no hubieran seleccionado, editado y diseminado dichos relatos. Un dilema complicado para toda red humana es que los creadores de mitos y los burócratas tienden a tomar direcciones opuestas. Numerosas instituciones y sociedades se definen por el equilibrio que consiguen establecer en la pugna entre las necesidades de sus creadores de mitos y las de sus burócratas. La propia Iglesia cristiana se dividió en iglesias rivales, como la católica y la protestante, que alcanzaron equilibrios de varios tipos entre la mitología y la burocracia.

A continuación, el capítulo 4 se centra en el problema de la información errónea y en las ventajas y los inconvenientes de mantener mecanismos de autocorrección como tribunales independientes o revistas científicas revisadas por pares. Este capítulo compara instituciones basadas en mecanismos débiles de autocorrección, como la Iglesia católica, con instituciones que han desarrollado fuertes mecanismos de autocorrección, como las disciplinas científicas. A veces los mecanismos de autocorrección débiles conducen a calamidades históricas, como la caza de brujas que tuvo lugar en Europa a principios de la Edad Moderna, mientras que en ocasiones los mecanismos de autocorrección sólidos desestabilizan la red desde dentro. Si se considera en términos de longevidad, extensión y poder, la Iglesia católica tal vez haya sido la institución más exitosa de la historia de la humanidad, a pesar —o quizá a causa— de la relativa debilidad de sus mecanismos de autocorrección.

Después de repasar en la primera parte del libro el papel de la mitología y el de la burocracia, así como el contraste entre los mecanismos de autocorrección fuertes y débiles, el capítulo 5 concluye la exposición histórica centrándose en otro contraste, el que se da entre las redes de información distribuidas y las centralizadas. Los sistemas democráticos permiten que la información fluya libremente a través de muchos canales independientes, mientras que los sistemas totalitarios se esfuerzan por concentrar la información en un núcleo. Cada elección tiene ventajas e inconvenientes. Entender sistemas políticos como el de Estados Unidos o la Unión Soviética en términos de flujos de información puede explicar mucho acerca de sus diferentes trayectorias.

La parte histórica del libro es esencial para entender los acontecimientos del presente y los supuestos del futuro. Puede afirmarse que la aparición de la IA es la mayor revolución de la información que ha conocido la historia. Pero no la podremos comprender a menos que la comparemos con sus predecesoras. La historia no es el estudio del pasado, sino el estudio del cambio. La historia nos enseña lo que se mantiene inmutable, lo que cambia y cómo cambian las cosas. Esto es tan relevante para las revoluciones de la información como para cualquier otro tipo de transformación histórica. Así, entender el proceso por el que la Biblia, supuestamente infalible, fue canonizada nos proporciona importantes conocimientos acerca de la infalibilidad que hoy se atribuye a la IA. De modo similar, episodios como la caza de brujas de inicios de la Edad Moderna y la colectivización de Stalin ofrecen a cualquiera que los estudie duras advertencias sobre lo que podría ir mal si concedemos a la IA un mayor control sobre las sociedades del siglo XXI. Asimismo, un conocimiento cabal de la historia es vital para comprender qué novedades ofrece la IA, en qué se diferencia de la imprenta y de la radio, y de qué maneras específicas una futura dictadura de la IA podría ser muy distinta de lo que hemos conocido hasta ahora.

El libro no defiende que estudiar el pasado nos permita predecir el futuro. Tal como se subraya en repetidas ocasiones a lo largo de las páginas que siguen, la historia no es determinista, y las decisiones que tomemos en los años venideros servirán para moldear el futuro. La escritura de este libro tiene como objetivo principal que, al tomar decisiones bien fundadas, prevengamos el peor de los desenlaces. Si no podemos cambiar el futuro, ¿por qué perder el tiempo hablando de él?

A partir de la perspectiva histórica general que se ofrece en la parte I, la segunda parte del libro —«La red inorgánica»— examina la nueva red de información que estamos creando en la actualidad y se centra en las implicaciones políticas del auge de la IA. Los capítulos 6, 7 y 8 exponen ejemplos recientes en todo el mundo —como el papel de los algoritmos de las redes sociales a la hora de instigar la violencia étnica en Myanmar en 2016-2017— para explicar en qué se diferencia la IA del resto de las tecnologías de la información previas. Los ejemplos se refieren a la década de 2010 más que a la de 2020, porque ya hemos adquirido cierta perspectiva histórica sobre los acontecimientos de la década de 2010.

La segunda parte sostiene que estamos creando un tipo totalmente nuevo de red de información sin detenernos en calcular sus implicaciones. Pone énfasis en el paso de las redes de información orgánicas a las redes inorgánicas. El Imperio romano, la Iglesia católica, la Unión Soviética dependían todos de cerebros compuestos de carbono para procesar la información y tomar decisiones. Los ordenadores compuestos de silicio que dominan la nueva red de información funcionan de maneras muy distintas. Para lo bueno y para lo malo, los chips de silicio están libres de muchas de las limitaciones que la bioquímica orgánica impone a las neuronas de carbono. Los chips de silicio pueden generar espías que nunca duermen, banqueros que nunca olvidan y déspotas que nunca mueren. ¿Cómo cambiará esto la sociedad, la economía y la política?

La tercera y última parte del libro —«Política informática»— examina el modo en que los diferentes tipos de sociedades pueden lidiar con las amenazas y las promesas de la red inorgánica de información. ¿Tendremos los seres vivos compuestos de carbono alguna probabilidad de comprender y controlar la nueva red de información? Como ya se ha dicho, la historia no es determinista, y al menos durante unos cuantos años los sapiens tendremos el poder de moldear nuestro futuro.

En consecuencia, el capítulo 9 explora cómo pueden lidiar las democracias con la red inorgánica. Por ejemplo, ¿cómo pueden los políticos de carne y hueso tomar decisiones económicas si el sistema económico está cada vez más controlado por la IA y el sentido mismo del dinero va camino de depender de algoritmos inescrutables? ¿Cómo pueden las democracias mantener un debate público sobre cualquier asunto —ya sea sobre economía o sobre cuestiones de género— cuando ya no podemos saber si estamos hablando con otro humano o con un chatbot disfrazado de humano?

El capítulo 10 explora el impacto que la red inorgánica podría tener sobre el totalitarismo. Aunque los dictadores estarían encantados de librarse de todo tipo de debate público, también tienen sus propios miedos con respecto a la IA. Las autocracias se basan en el terror y la censura sobre sus propios representantes. Pero ¿cómo puede un dictador humano aterrorizar a una IA, censurar sus procesos insondables o impedir que se haga con el poder?

Para concluir, el capítulo 11 explora de qué modo la nueva red de información puede influir sobre el equilibrio de poder entre las sociedades democráticas y las totalitarias a nivel global. ¿Acaso la IA inclinará definitivamente la balanza a favor de un lado? ¿Se dividirá el mundo en bloques hostiles cuya rivalidad haga que todos nos convirtamos en presa fácil de una IA descontrolada? ¿O bien podremos unirnos en defensa de unos intereses comunes?

Pero, antes de explorar el pasado, el presente y los posibles futuros de las redes de información, debemos empezar con una pregunta que puede parecer simple: ¿qué es exactamente la información?

Tabla de Contenido

Nexus

Prólogo

Parte I. Redes humanas

- ¿Qué es la información?

- Relatos: conexiones ilimitadas

- Documentos: el mordisco de los tigres de papel

- Errores: la fantasía de la infalibilidad

- Decisiones: una breve historia de la democracia y el totalitarismo

Parte II. La red inorgánica

- Los nuevos miembros: en qué se diferencian los ordenadores de las imprentas

- Incansable: la red siempre está activa

- Falible: la red suele equivocarse

Parte III. Política informática

- Democracias: ¿podemos mantener todavía una conversación?

- Totalitarismo: ¿todo el poder para los algoritmos?

- El Telón de Silicio: ¿imperio global o fisura global?

Epilogo

Agradecimientos

Sobre este libro

Sobre Yuval Noah Harari

Créditos

Notas